使用 Nowledge Mem

你的知识如何通过 Timeline、AI 工具、搜索和 AI Now 为你服务

如果你还不知道先怎么用 Mem

先回到 从这里开始 和 如何确认 Mem 已经在工作。当你已经先完成一次保存、找回、再给工具使用的过程以后,这一页会更容易理解。

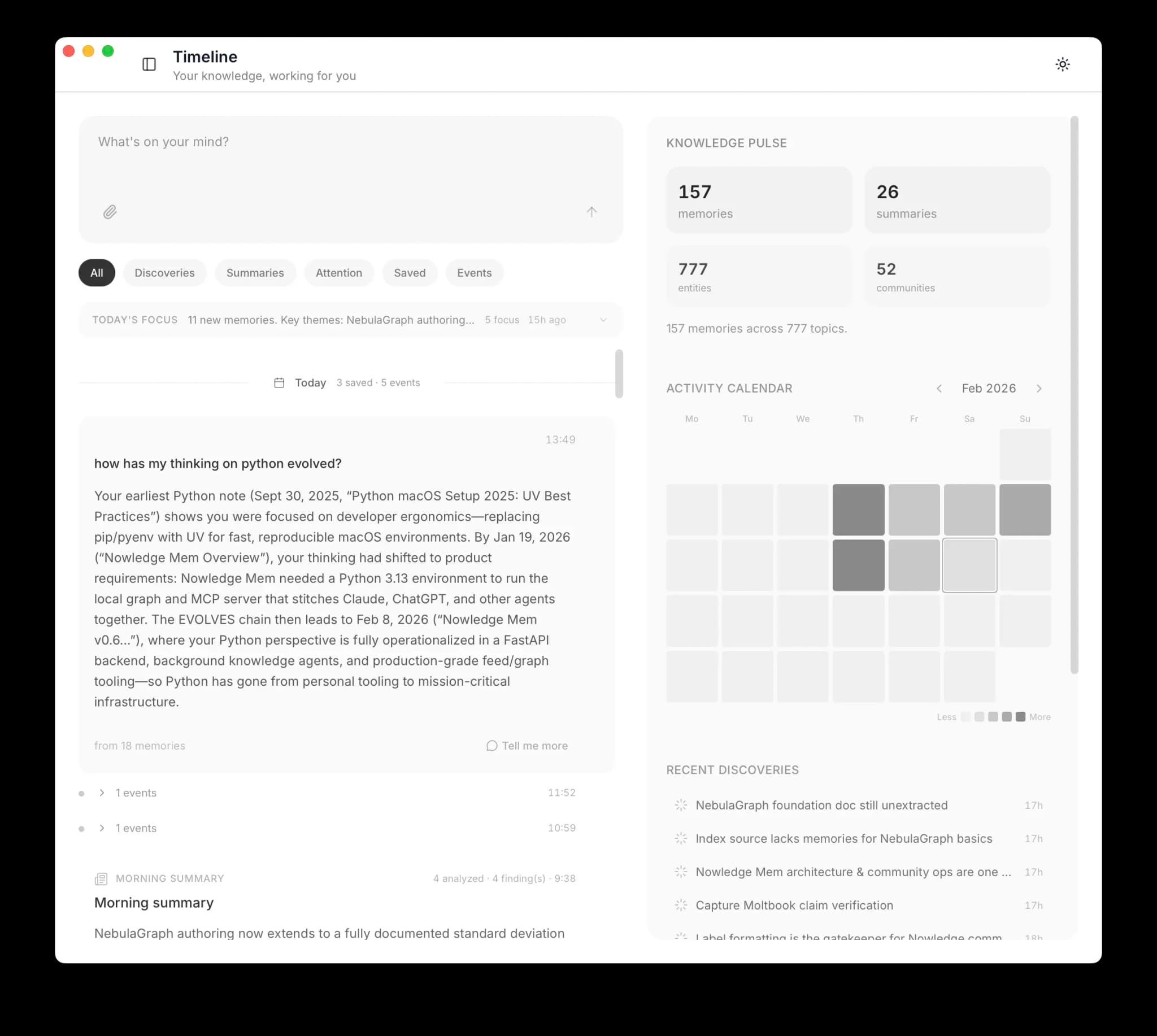

Timeline

Timeline 是你的主页。你捕获的、你提问的、系统自己发现的,都在一个流里。

你会看到什么

Timeline 中会出现这些类型:

| 项目 | 说明 |

|---|---|

| Capture | 你保存的记忆,自动生成标题和标签 |

| Question | 你的提问和 AI 基于知识库给出的回答 |

| URL Capture | 抓取、解析并存储的网页 |

| Insight | 系统在你的记忆之间发现的关联 |

| 知识结晶 | 对多条相关记忆的综合提炼 |

| 标记 | 矛盾信息、过时内容或需要验证的观点 |

| 工作记忆 | 你的每日晨间简报 |

不需要手动整理。

你的 AI 工具

把你真正使用的 AI 工具连接到知识库里。Claude Code、Cursor、Codex、OpenCode、Alma、DeepChat、LobeHub 等,都可以通过合适的路径连接回同一个记忆系统。

如果你还在判断某个工具该怎么接入,请先看集成。这一页讲的是:当其中一条路径已经接通之后,Mem 用起来会是什么感觉。

没有 Mem: "帮我给 API 加缓存。" 智能体通常会继续追问你用什么技术栈、什么基础设施、什么偏好。你从头解释一遍。

有 Mem: "帮我给 API 加缓存。" 智能体可以搜索你的知识,找到上个月的 Redis 决策和 API 限流方案,更快写出符合你架构的代码,少很多重复解释。

在集成做得好的情况下,这一步不需要你反复提醒。原生集成、配置好的复用型工作流包,或带有清晰意图规则的 MCP 客户端,都会在需要时主动去找你的知识。

今天在 Claude Code 中保存一条洞察,明天 Cursor 遇到同一主题时自动找到。不需要导出,不需要复制。

你也可以直接询问 Agent:"上个月我对数据库迁移做了什么决定?",它会搜索你的知识来回答。

详见集成了解设置说明。

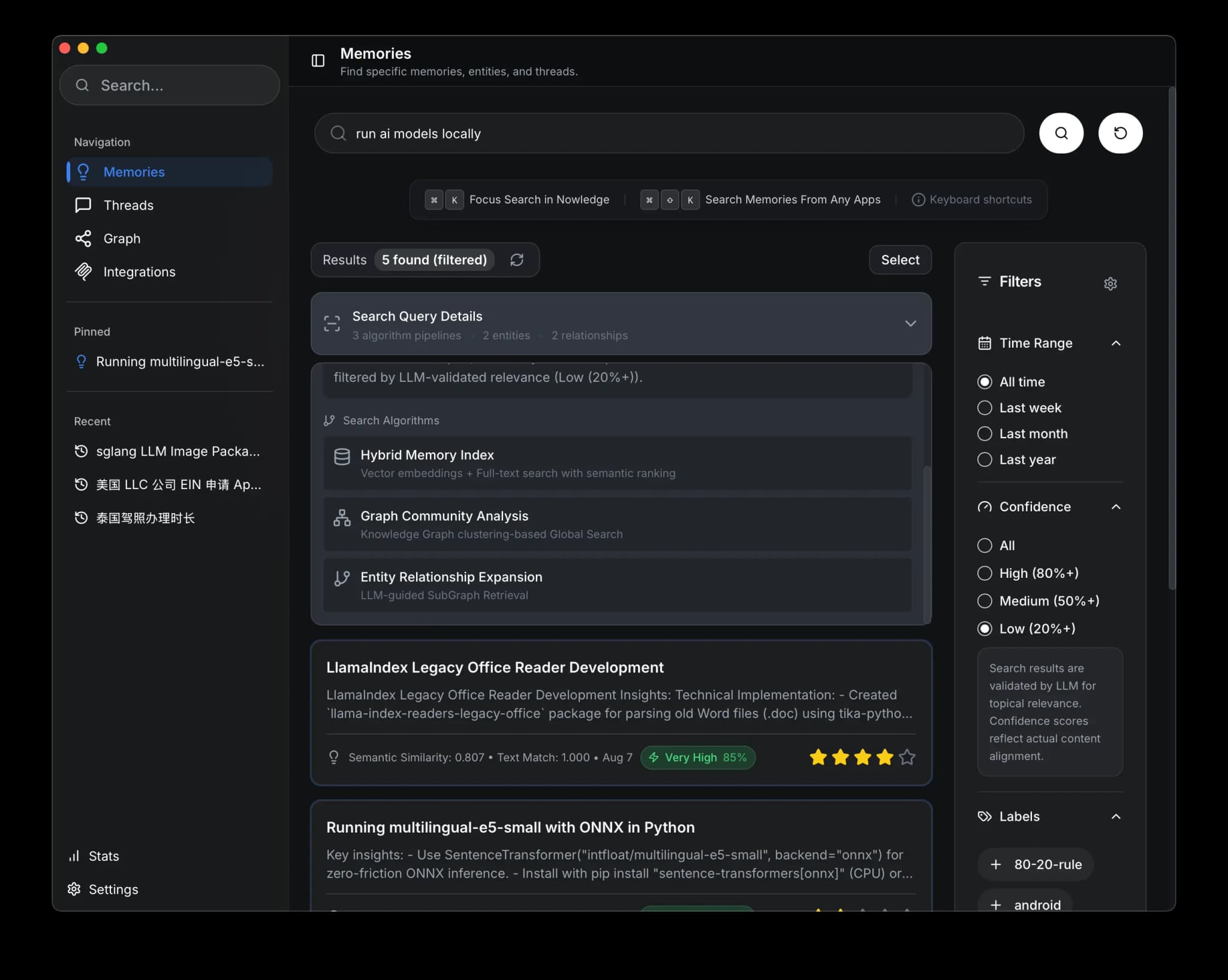

搜索

应用内

按 Cmd + K(macOS)打开记忆搜索。搜索理解语义,不仅仅是关键词。搜索"设计模式"会找到关于"架构方法"的记忆。

三种搜索模式协同工作:

- 语义搜索:按含义查找记忆

- 关键词搜索:精确匹配特定术语

- 图搜索:通过连接和关系发现记忆

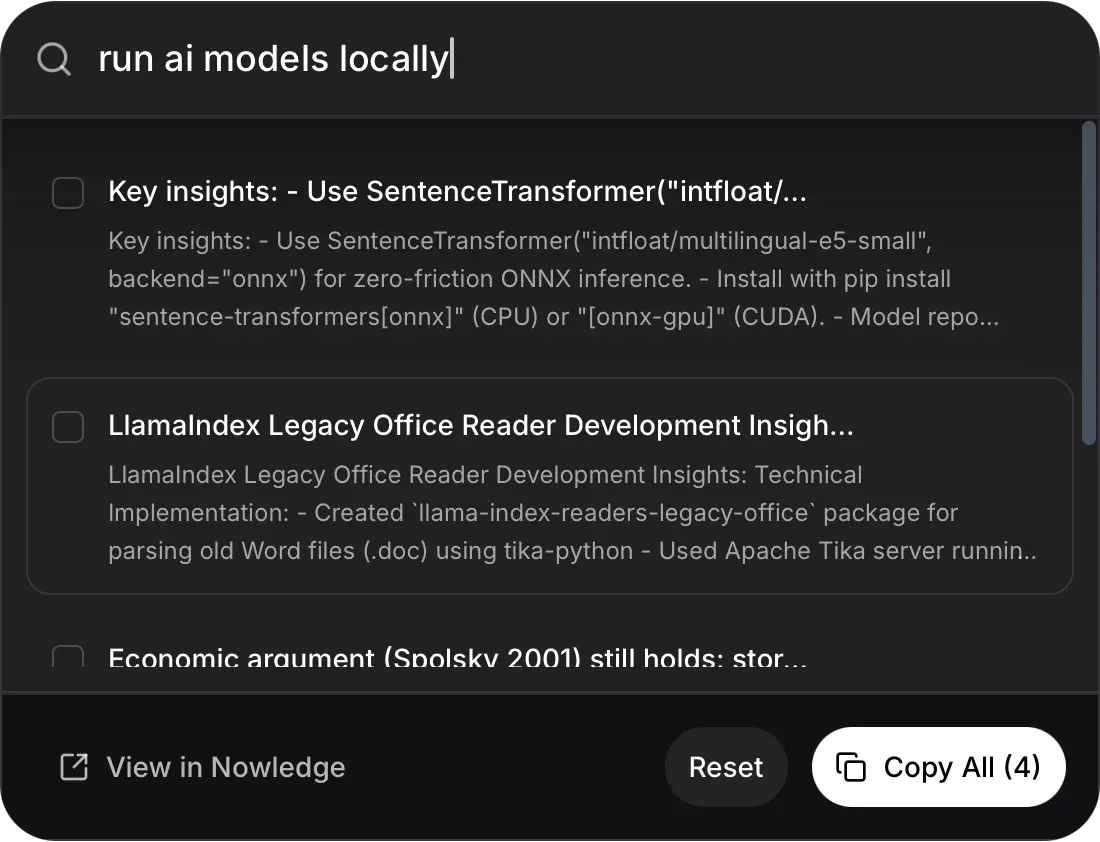

全局搜索

全局启动器让你无需打开 Nowledge Mem 就能搜索。在任何应用中按 Cmd + Shift + K,搜索后直接将结果粘贴到需要的地方。如果你使用 Raycast,Nowledge Mem 扩展可以将同样的搜索直接带入你的启动器。

知识如何随时间成长

持续使用几周后,系统会开始在后台帮你整理线索。

周二你保存了一条 PostgreSQL 决策。周四你提到 CockroachDB 是迁移目标。周五早上,Working Memory 简报写道:"你的数据库选型在演变。"

这就是后台智能:

- 知识演变 — 检测到你对同一话题的想法在变化,自动链接各个版本。

- 知识结晶 — 将分散的记忆综合为参考文章。

- 标记 — 发现过去和现在的想法矛盾时主动提示。

- 工作记忆 — 每日简报,AI 工具开始会话时自动读取。

使用条件

后台智能需要已配置的远程 LLM,以及你的当前版本所对应的许可能力。

AI Now

连接到你的 Mem 服务器的个人 AI 工作区,可以使用你保存的知识、连接的笔记、文件和已启用的插件。同一组会话可在桌面端、网页版和移动端继续使用。详见 AI Now 完整指南。

命令行

nmem CLI 让你从任何终端获得完整访问:

# 搜索你的记忆

nmem m search "authentication patterns"

# 添加记忆

nmem m add "We chose JWT with 24h expiry for the auth service"

# JSON 输出用于脚本

nmem --json m search "API design" | jq '.memories[0].content'详见 CLI 参考获取完整命令集。

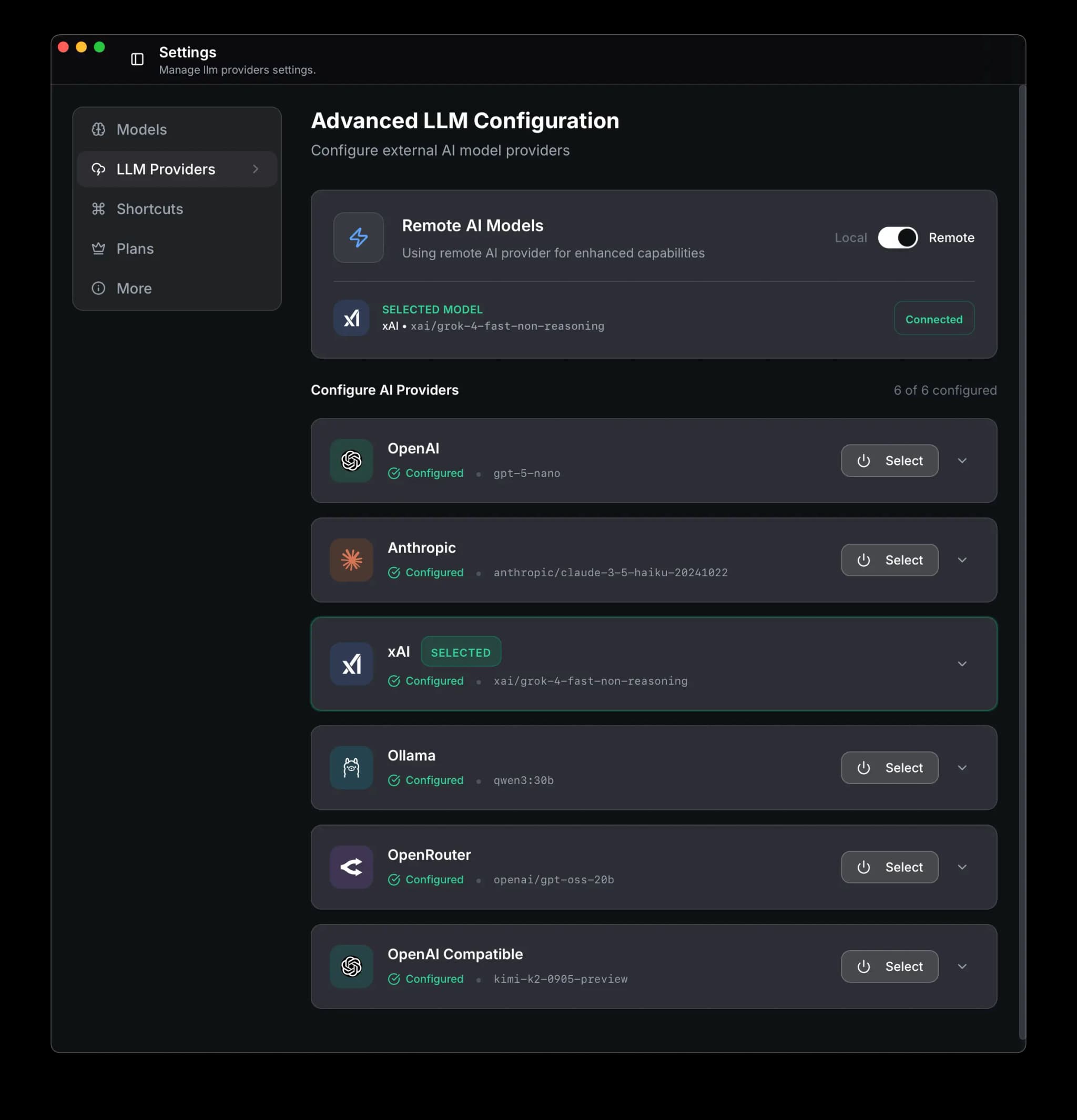

远程 LLM

默认在本地运行,不需要联网。知识库增长后,远程 LLM 能给你更强的处理能力。

可用性

远程 LLM 配置取决于你当前使用的版本和许可方式。

解锁的功能:

- 后台智能:自动发现关联、生成知识结晶、产出洞察以及每日简报

- 更快的知识图谱提取

- 更细腻的语义理解

- AI Now Agent 能力

隐私: 你的数据仅发送到你选择的 LLM 提供商,永远不会发送到 Nowledge Mem 服务器。你可以随时切换回纯本地模式。